Бывает типичная ситуация: вы запустили сайт, всё красиво, всё работает, ждёте месяц, два, иногда даже полгода — а в поиске ничего не происходит. Сайт не появляется по названию компании, не видно страниц, заявок из поиска нет.

И речь сейчас не про то, что сайт “плохо продвигается”. Иногда проблема гораздо банальнее: сайт просто закрыт от индексации. То есть поисковые системы его не обходят или не добавляют страницы в базу.

Это частая ошибка, и, что особенно обидно, часто она решается за 5–10 минут.

Что такое индексация простыми словами

Индексация — это процесс, когда поисковая система:

- заходит на ваш сайт,

- читает страницы,

- добавляет их в свою базу,

- и только после этого может показывать их в выдаче.

Если сайт закрыт от индексации, то для Яндекса и Google его как будто почти не существует.

Почему сайт может быть скрыт от индексации

1) Сайт закрыли на этапе разработки и забыли открыть

Это самая частая причина.

Когда сайт делают в веб-студии, его часто специально закрывают от поисковых систем, чтобы в индекс не попали:

- тестовые страницы,

- черновики,

- недоделанная верстка,

- временные тексты.

Это нормальная практика. Проблема возникает, когда после запуска сайта его забывают открыть обратно.

Такое бывает:

- в студиях, которые не занимаются SEO,

- в студиях, которые SEO занимаются, но сработал человеческий фактор,

- при переносе сайта на новый домен,

- после обновлений или переезда.

2) Закрытие через настройки CMS

Во многих системах управления сайтом есть встроенная настройка запрета индексации.

Например, в WordPress есть опция, которая запрещает поисковым системам индексировать сайт. Если эта галочка включена — сайт может не попадать в поиск.

На WordPress это обычно выглядит так:

- “Попросить поисковые системы не индексировать сайт”

- или похожая формулировка в настройках чтения

Если галочка стоит — её нужно снять.

3) Ошибка в файле robots.txt

Вторая очень частая причина — неправильно настроенный файл robots.txt.

Если в нём прописан запрет на весь сайт, поисковики просто не будут его нормально индексировать.

Например, опасная запись выглядит так:

User-agent: *

Disallow: /

Это означает: запретить индексацию всего сайта.

Если такая строчка стоит без понимания, зачем она нужна, — это критическая ошибка.

Часто сайт не индексируется не из-за SEO, а из-за банального запрета в настройках или robots.txt.

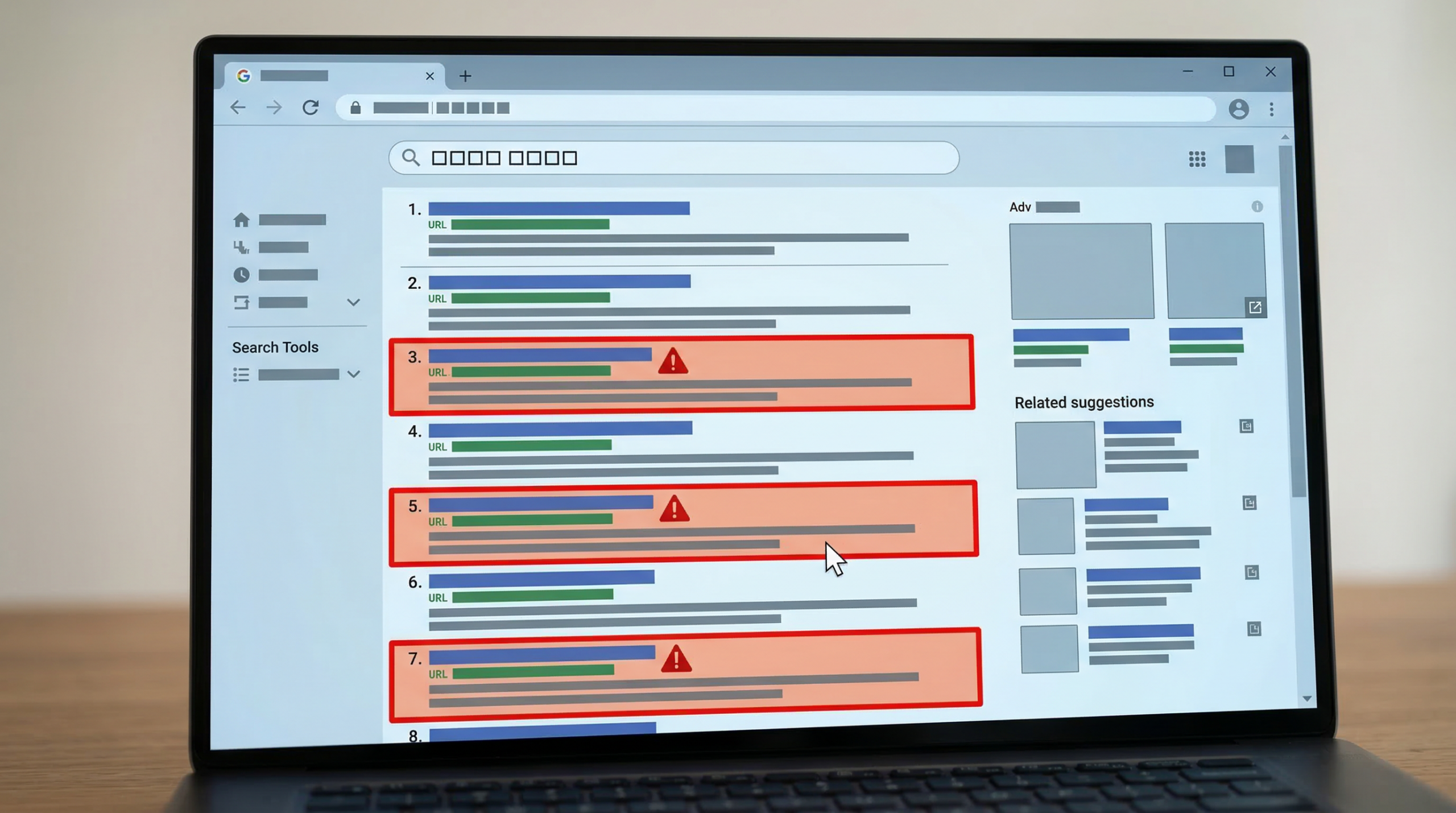

Как быстро проверить, есть ли сайт в индексе

Самый простой способ — проверить через поиск Яндекса.

Открываете Яндекс и вводите запрос вида:

site:вашдомен.ru

Важно:

- без

https:// - без слэшей

- без пробелов

- просто домен

Например:

site:example.ru

После этого вы увидите страницы сайта, которые уже есть в индексе.

Что это даёт

Так можно быстро понять:

- индексируется ли сайт вообще;

- какие страницы уже в поиске;

- нет ли важных страниц, которые не попали в индекс;

- нет ли подозрительных страниц, которых вы не создавали.

Заодно можно проверить сайт на вирусы и мусорные страницы

Этот же способ полезен ещё и для диагностики взлома.

Если сайт заражён, в индексе иногда появляются:

- страницы с японскими иероглифами,

- мусорные карточки товаров,

- ссылки на казино,

- странные URL, которых вы никогда не создавали.

Если видите такое — это уже не просто проблема индексации, а повод срочно проверять сайт на взлом и вредоносный код.

Проверка через site: помогает увидеть не только индексацию, но и подозрительные страницы после взлома.

Более продвинутый способ: Яндекс.Вебмастер

Если сайт уже подключён к Яндекс.Вебмастеру, это вообще лучший вариант для контроля индексации.

Там можно посмотреть:

- какие страницы находятся в индексе,

- какие исключены,

- какие заблокированы,

- какие признаны малоценными,

- есть ли ошибки обхода,

- есть ли проблемы с

robots.txt, - как Яндекс вообще видит ваш сайт.

Это очень полезный инструмент не только для SEO-специалистов, но и для владельцев сайтов.

Если вы ещё не подключали Яндекс.Вебмастер — обязательно сделайте это. Даже базовая информация оттуда уже может помочь понять, почему сайт не растёт в поиске.

Что проверить в первую очередь, если сайт не индексируется

Вот простой чек-лист:

- Снят ли запрет индексации в CMS

- Нет ли в

robots.txtполного запрета черезDisallow: / - Открывается ли сайт без ошибок

- Есть ли страницы в поиске по запросу

site:вашдомен.ru - Нет ли мусорных или вирусных страниц в индексе

- Подключён ли Яндекс.Вебмастер

- Не заблокирован ли обход сайта технически

Важный момент: отсутствие позиций ≠ отсутствие индексации

Иногда владельцы сайтов путают две ситуации:

Сайт не индексируется

Это когда страниц вообще нет или почти нет в поиске.

Сайт индексируется, но не растёт

Это уже другая история:

- слабая оптимизация,

- нет контента,

- высокая конкуренция,

- плохие коммерческие факторы,

- слабая ссылочная история и т.д.

Поэтому сначала нужно понять базу:

сайт вообще открыт для поисковиков или нет?

Сначала проверяем, открыт ли сайт для индексации, и только потом думаем о продвижении.

Вывод

Если сайт долго не появляется в поиске, не спешите думать, что “SEO не работает”. Очень часто проблема в другом: сайт просто закрыт от индексации.

Проверьте:

- настройки CMS,

- файл

robots.txt, - наличие страниц по запросу

site:домен, - и данные в Яндекс.Вебмастере.

Это базовая техническая проверка, которую стоит делать сразу после запуска сайта и после любых серьёзных доработок.

Если хотите, мы можем:

- проверить, открыт ли ваш сайт для индексации,

- найти ошибки в

robots.txtи настройках CMS, - посмотреть, какие страницы уже есть в поиске,

- проверить сайт на мусорные/вирусные страницы,

- и помочь с разовой оптимизацией или дальнейшим продвижением сайта.